Sujets

- À propos de mon travail créatif

- Utilisation d'outils 3D pour des résultats 2D

- Travail avec l'Intelligence Artificielle (IA) générative

À propos de mon travail créatif

Tintin

J'ai grandi en lisant et en admirant la 'ligne claire' d'Hergé et d'autres maîtres de la bande dessinée européenne. J'ai appris plus tard que leur travail était inspiré par l'art japonais (en particulier Hergé, avec l'influence des estampes sur bois d'Hiroshige).

Bien que j'aie commencé par le côté ingénierie des graphiques, avec l'infographie 2D, j'ai été attiré par le côté créatif. J'ai appris les arts visuels et le design, en commençant par la 2D, puis en me concentrant sur l'art 3D et maintenant sur le travail avec l'Intelligence Artificielle (IA) générative.

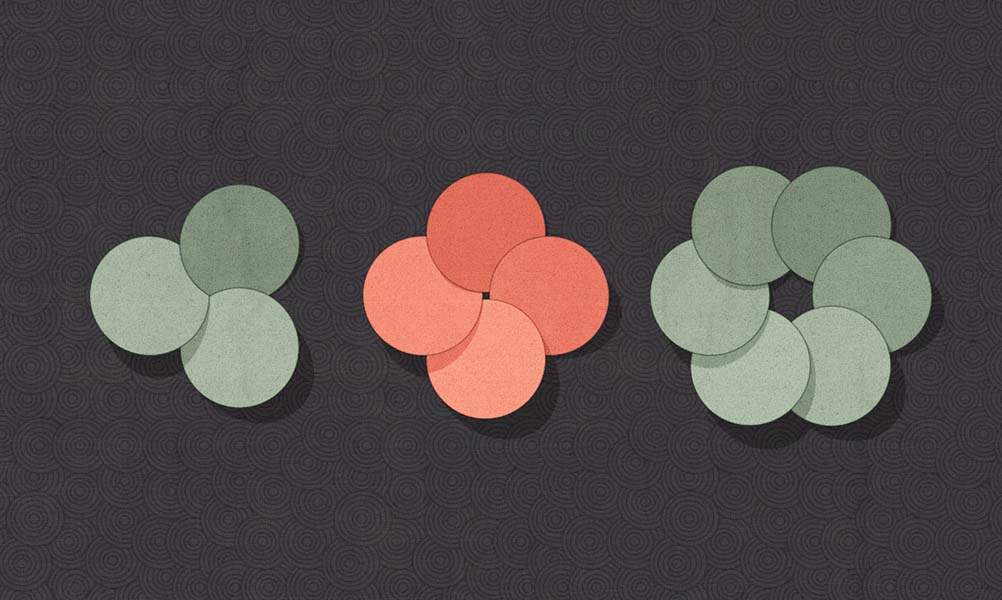

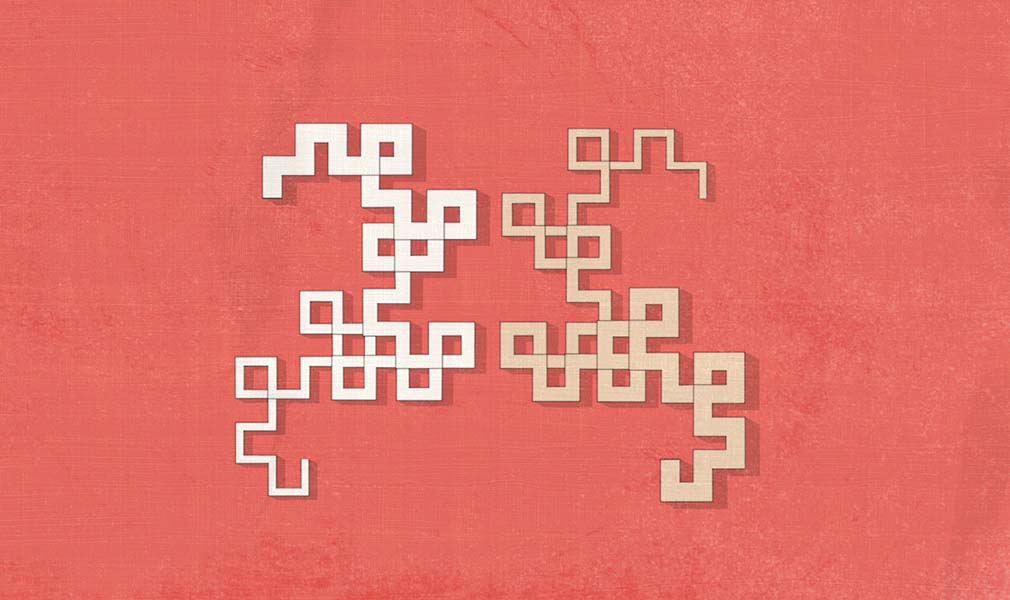

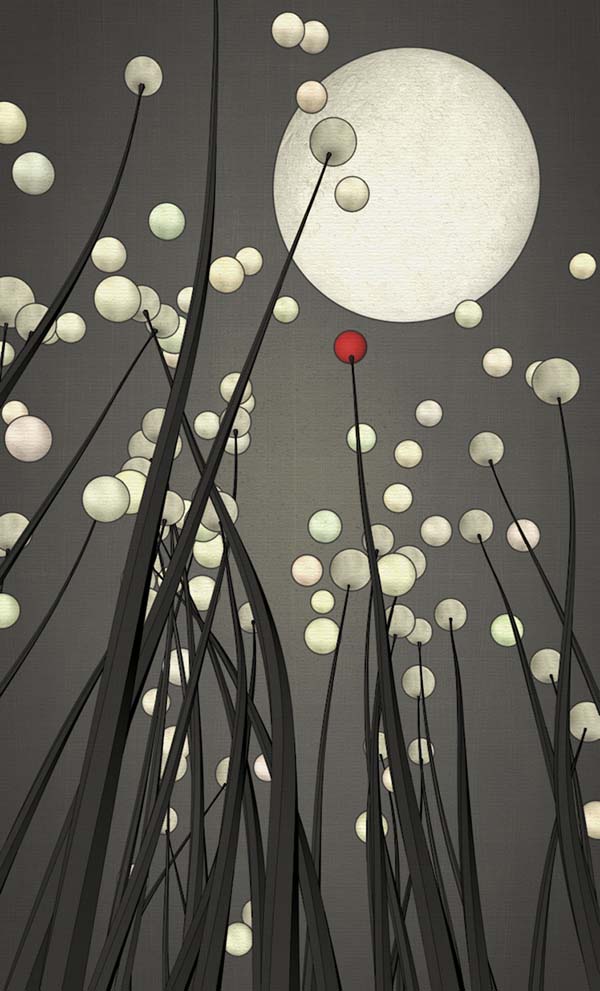

Travail 3D

La raison de ma gravitation vers l'art 3D est la puissance pure des outils 3D comme Cinema 4D de Maxon, qui permettent de créer des mondes entiers et des scènes complexes avec des efforts relativement limités. Ces outils offrent aussi une flexibilité époustouflante par rapport à d'autres solutions (certainement les médias traditionnels, mais aussi les environnements graphiques 2D). Par exemple, si vous n'aimez pas l'angle d'une image vers un bâtiment, vous pouvez toujours changer le point de vue et l'angle de la caméra. Dans d'autres solutions, vous devez essentiellement redessiner et recréer la nouvelle scène, en espérant qu'elle répondra à vos attentes.

Malgré mon attrait pour les outils 3D, j'ai toujours la même passion pour le rendu 2D et le type d'estampes sur bois mentionné précédemment.

Ainsi, après avoir appris à utiliser Cinema 4D, j'ai orienté mes efforts plus spécifiquement vers le rendu et la tentative d'obtenir des rendus qui rappellent davantage l'art 2D traditionnel.

Vous pouvez trouver plus de mon travail sur Behance. Voici quelques exemples.

Blasons japonais

Abstrait

Clair de lune

Plante abstraite

Travail avec l'Intelligence Artificielle (IA) générative

Mi-2022, j'ai commencé à en apprendre davantage sur le travail avec l'IA générative. Vous pouvez voir mes expérimentations dans ce domaine sur mon Instagram. Ce qui suit décrit mon processus d'utilisation de l'Intelligence Artificielle.

Outils IA et Processus

Il y a plusieurs acteurs dans le domaine de l'art génératif par Intelligence Artificielle. J'ai expérimenté principalement avec trois d'entre eux :

Un exemple d'utilisation de l'Intelligence Artificielle générative

Examinons un exemple concret : un portrait art déco que j'ai créé avec des outils d'IA. La figure suivante illustre les trois étapes principales.

- Étape 1 – Image brute générée par MidJourney (gauche)

- Étape 2 – Image retouchée avec DALL.E (centre)

- Étape 3 – Image après composition et texturisation dans Photoshop

Steps are described below in more details.

TRAVAILLER AVEC LES OUTILS IA ET PHOTOSHOP

MidJourney : Centrale créative (avec des imperfections)

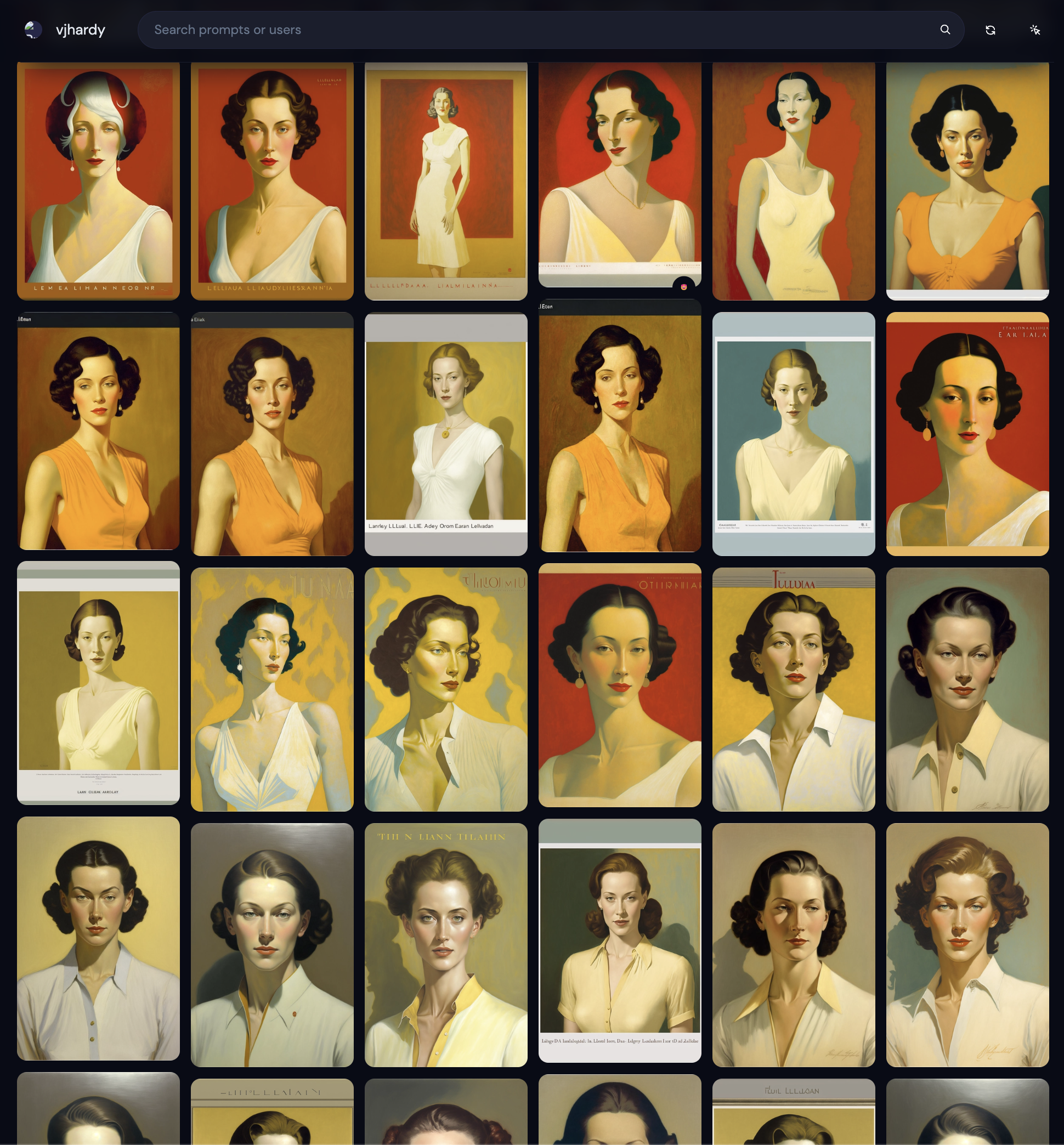

MidJourney génère des images à partir de prompts, c'est-à-dire des descriptions textuelles de l'image que vous souhaitez que MidJourney génère. C'est rapide (normalement moins d'une minute) et il est facile d'itérer sur les prompts pour essayer d'orienter le générateur vers ce que vous souhaitez. L'image ci-dessous est une capture d'écran de plusieurs itérations que MidJourney a créées alors que je variais et ajustais mes prompts.

MidJourney génère des images à partir de prompts, c'est-à-dire des descriptions textuelles de l'image que vous souhaitez que MidJourney génère. C'est rapide (normalement moins d'une minute) et il est facile d'itérer sur les prompts pour essayer d'orienter le générateur vers ce que vous souhaitez. L'image ci-dessous est une capture d'écran de plusieurs itérations que MidJourney a créées alors que je variais et ajustais mes prompts.

ITÉRATIONS MIDJOURNEY

Le prompt avec lequel je me suis arrêté pour cette image était :

Notez que le prompt contient des éléments décrivant le sujet, la composition, le style et même l'ambiance.

L'itération sur le prompt supprime ou modifie parfois des parties de l'image. Je garde donc souvent une image imparfaite avec des parties que j'aime vraiment puisque j'ai d'autres moyens de la corriger ou de l'utiliser. C'était le cas pour l'image de cette première étape : bien que j'aimais le résultat général, je ne voulais pas le cadre orange, je voulais une coiffure différente et je voulais étendre le bas du corps. Ma prochaine étape était de retoucher l'image dans DALL-E.

SORTIE BRUTE DE MIDJOURNEY

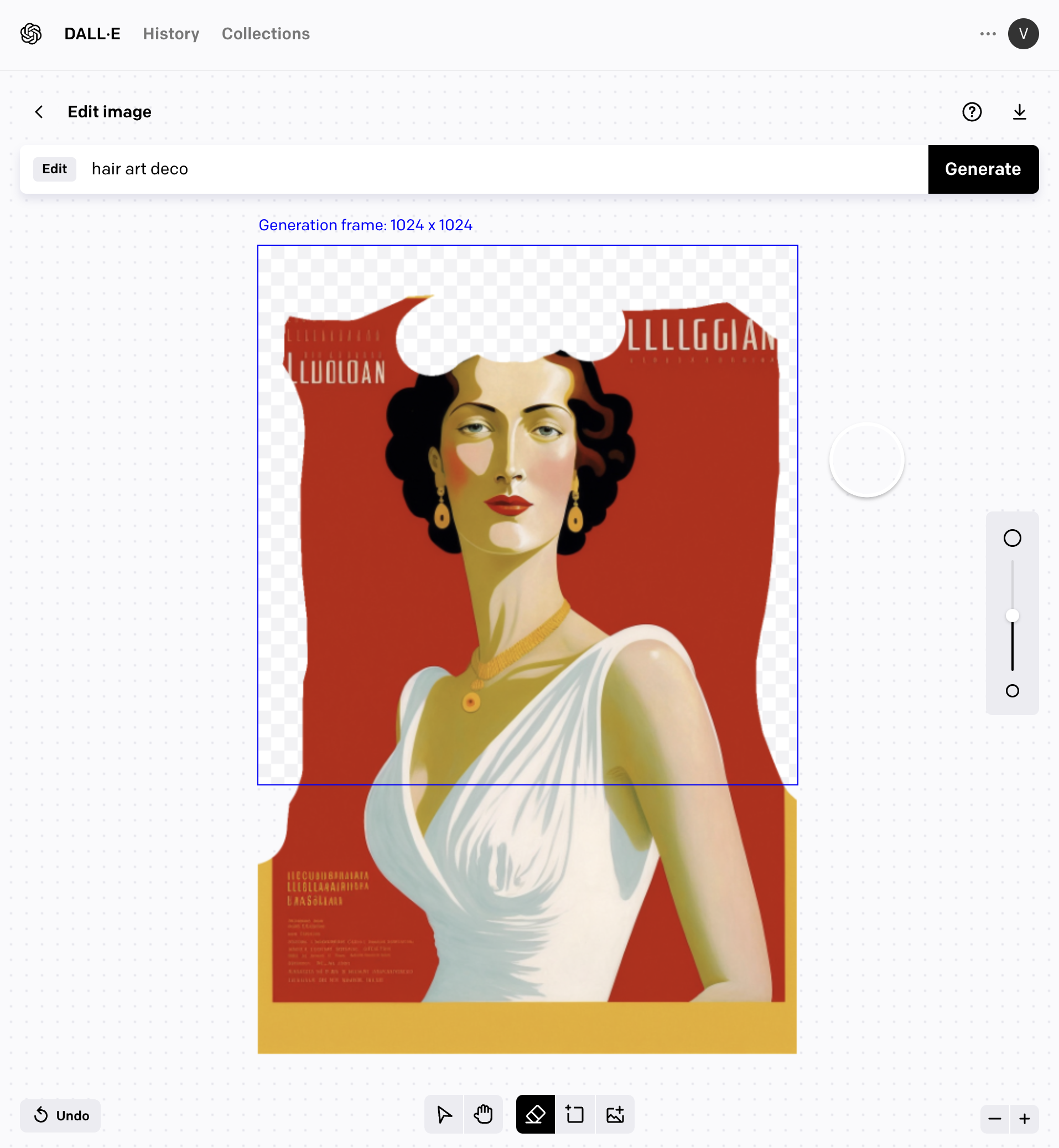

DALL-E : Retouches créatives

Dans la deuxième image, en la comparant à la sortie brute de MidJourney, vous voyez que j'ai utilisé DALLE-2 pour supprimer la partie inférieure du cadre orange et la remplacer par la partie inférieure du corps. Cela se fait en important la sortie MidJourney dans l'éditeur de DALL-E, en effaçant les parties que je n'aimais pas, puis en dirigeant DALL-E pour remplir ces zones avec un nouveau prompt. Ce processus s'appelle 'in painting'. Mon prompt était simplement :

Dans la deuxième image, en la comparant à la sortie brute de MidJourney, vous voyez que j'ai utilisé DALLE-2 pour supprimer la partie inférieure du cadre orange et la remplacer par la partie inférieure du corps. Cela se fait en important la sortie MidJourney dans l'éditeur de DALL-E, en effaçant les parties que je n'aimais pas, puis en dirigeant DALL-E pour remplir ces zones avec un nouveau prompt. Ce processus s'appelle 'in painting'. Mon prompt était simplement :

J'ai utilisé la même fonctionnalité avec le simple prompt hair pour retoucher la coiffure de la femme en haut de la tête et supprimer la partie blanche.

SORTIE DALLE-2

Ci-dessous est une capture d'écran de l'interface utilisateur simple de DALL-E. Notez l'outil gomme qui m'a permis d'effacer les parties que je voulais remplacer et le champ de texte en haut pour entrer le prompt désiré, qui décrit ce qui doit être peint dans les zones effacées.

INTERFACE UTILISATEUR DALLE-2

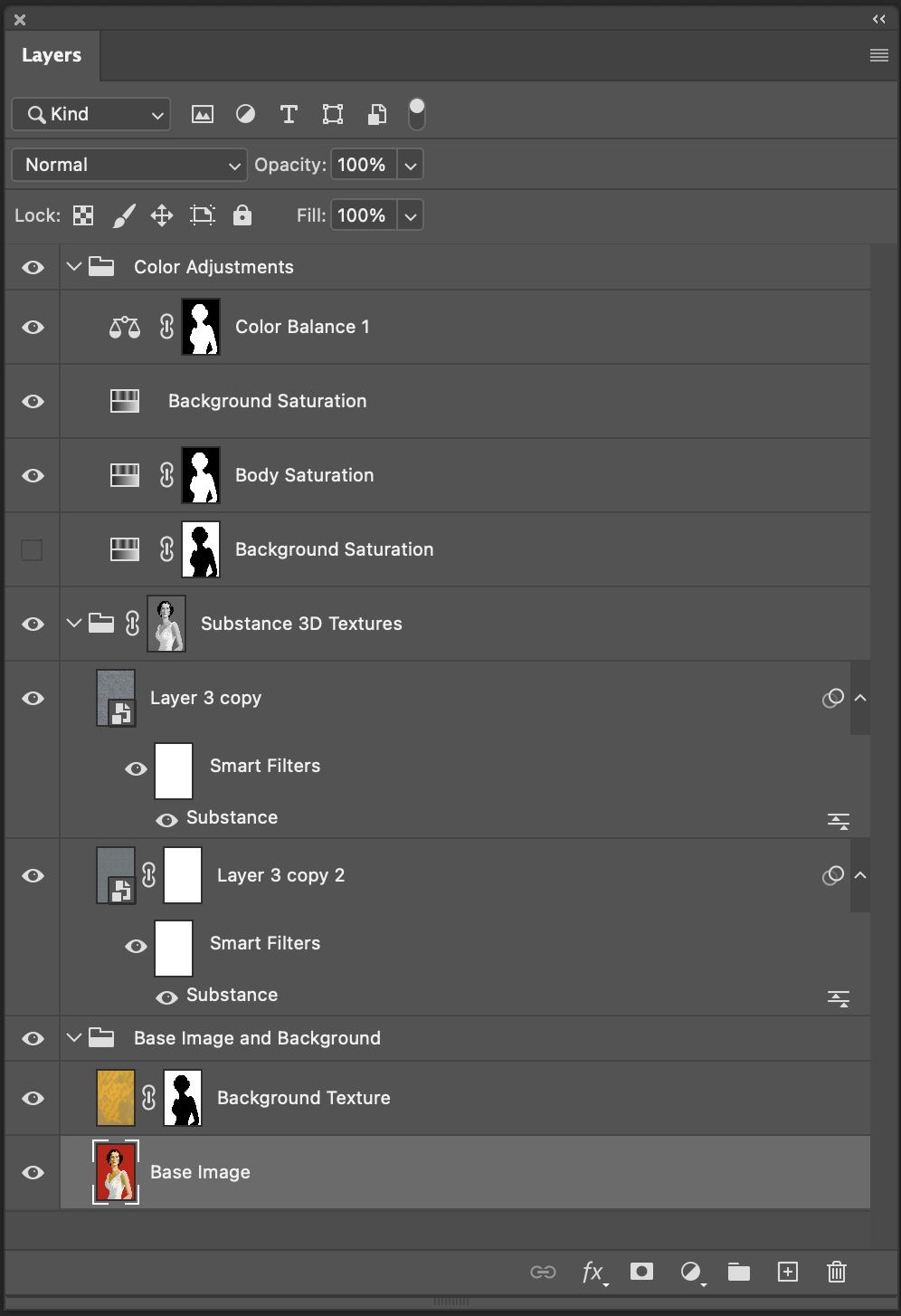

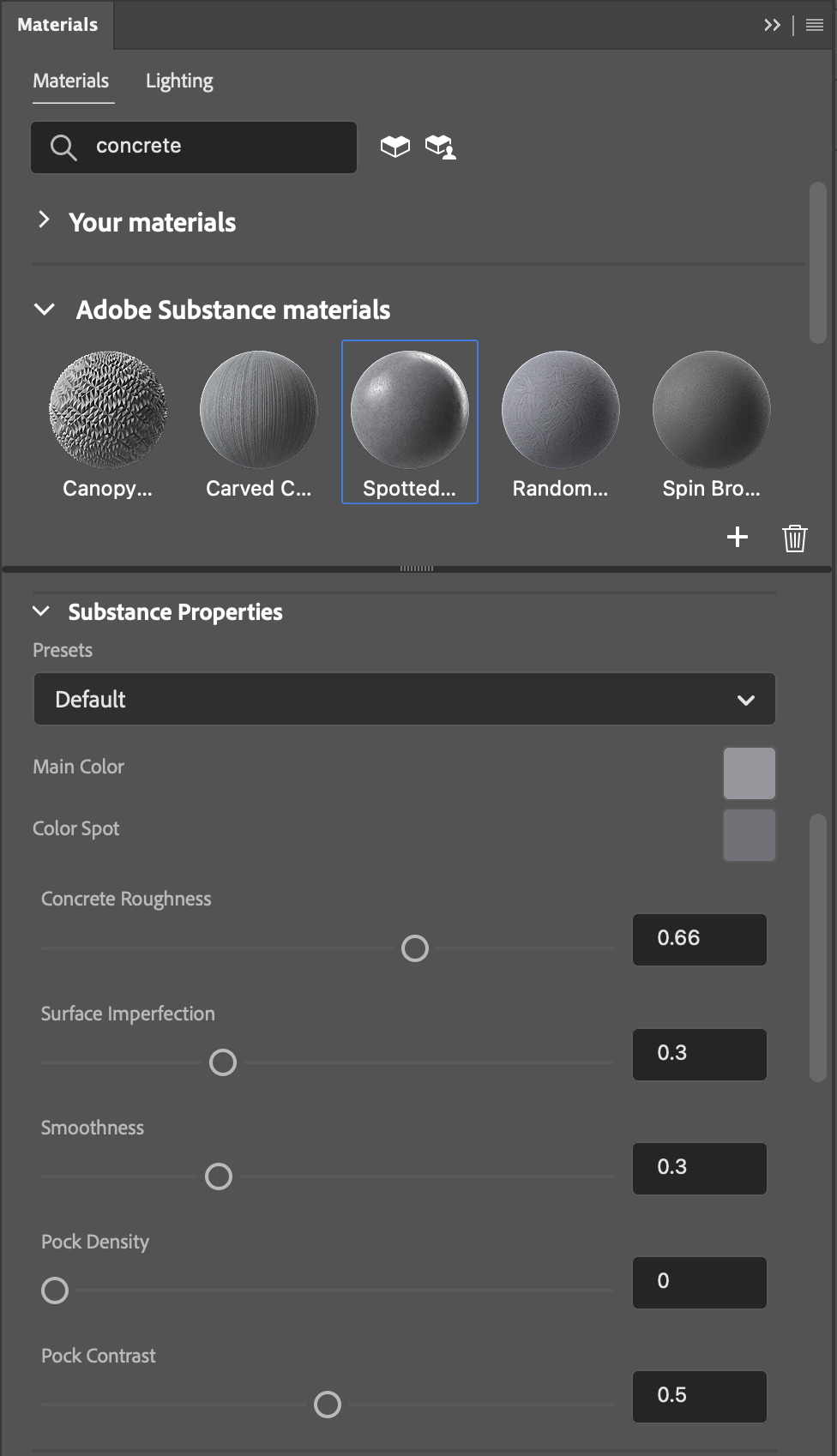

ÉTAPE 3 – Photoshop : Texturisation, Mise à l'échelle et Composition

J'ai importé l'image dans Photoshop et utilisé abondamment la fonction remplissage basé sur le contenu (elle fonctionne très bien pour supprimer des éléments comme le reste du cadre et le texte indésirable sur un fond assez simple), puis le masquage et la composition pour ajuster l'arrière-plan. Enfin, j'ai utilisé les matériaux Substance 3D pour donner de la texture à l'image. Ce sont des textures paramétriques (par opposition aux images simples) qui donnent beaucoup de contrôle créatif. Par exemple, j'utilise des textures de béton et de papier, et les matériaux Substance 3D me donnent le contrôle sur des paramètres tels que la rugosité, le contraste ou les variations de couleur.

J'ai importé l'image dans Photoshop et utilisé abondamment la fonction remplissage basé sur le contenu (elle fonctionne très bien pour supprimer des éléments comme le reste du cadre et le texte indésirable sur un fond assez simple), puis le masquage et la composition pour ajuster l'arrière-plan. Enfin, j'ai utilisé les matériaux Substance 3D pour donner de la texture à l'image. Ce sont des textures paramétriques (par opposition aux images simples) qui donnent beaucoup de contrôle créatif. Par exemple, j'utilise des textures de béton et de papier, et les matériaux Substance 3D me donnent le contrôle sur des paramètres tels que la rugosité, le contraste ou les variations de couleur.

MASQUAGE, COMPOSITION ET TEXTURISATION PHOTOSHOP

PHOTOSHOP AVEC TEXTURES SUBSTANCE 3D

REMPLISSAGE BASÉ SUR LE CONTENU PHOTOSHOP

IMAGE FINALE DE PHOTOSHOP

Autres utilisations des outils IA

J'utilise généralement les filtres neuronaux dans Photoshop pour des tâches importantes telles que :

- Mise à l'échelle avec "Super Zoom". Cela fonctionne très bien et je l'utilise pour obtenir une image en plus haute résolution venant de MidJourney / DALL-E.

- "Suppression des artefacts JPEG". Quand les images de MidJourney et DALL-E montrent des artefacts de compression.

- "Harmonisation des couleurs". Lors de la composition d'images dont les couleurs doivent être harmonisées.

De plus, j'utilise le filtre Fluidité. Ce filtre fonctionne très bien sur de nombreux types d'images, mais particulièrement avec les portraits : vous pouvez ajuster les traits du visage ou la position du corps par exemple.